[本站讯]近日,山东大学白露教授团队与北京大学程翔教授团队研究人员在Nature子刊Scientific Data发表了题为“SynthSoM: A synthetic intelligent multi-modal sensing-communication dataset for Synesthesia of Machines”的研究论文,正式发布公开的首个通信与多模态感知智能融合数据集(SynthSoM)。白露教授、程翔教授为共同通讯作者。

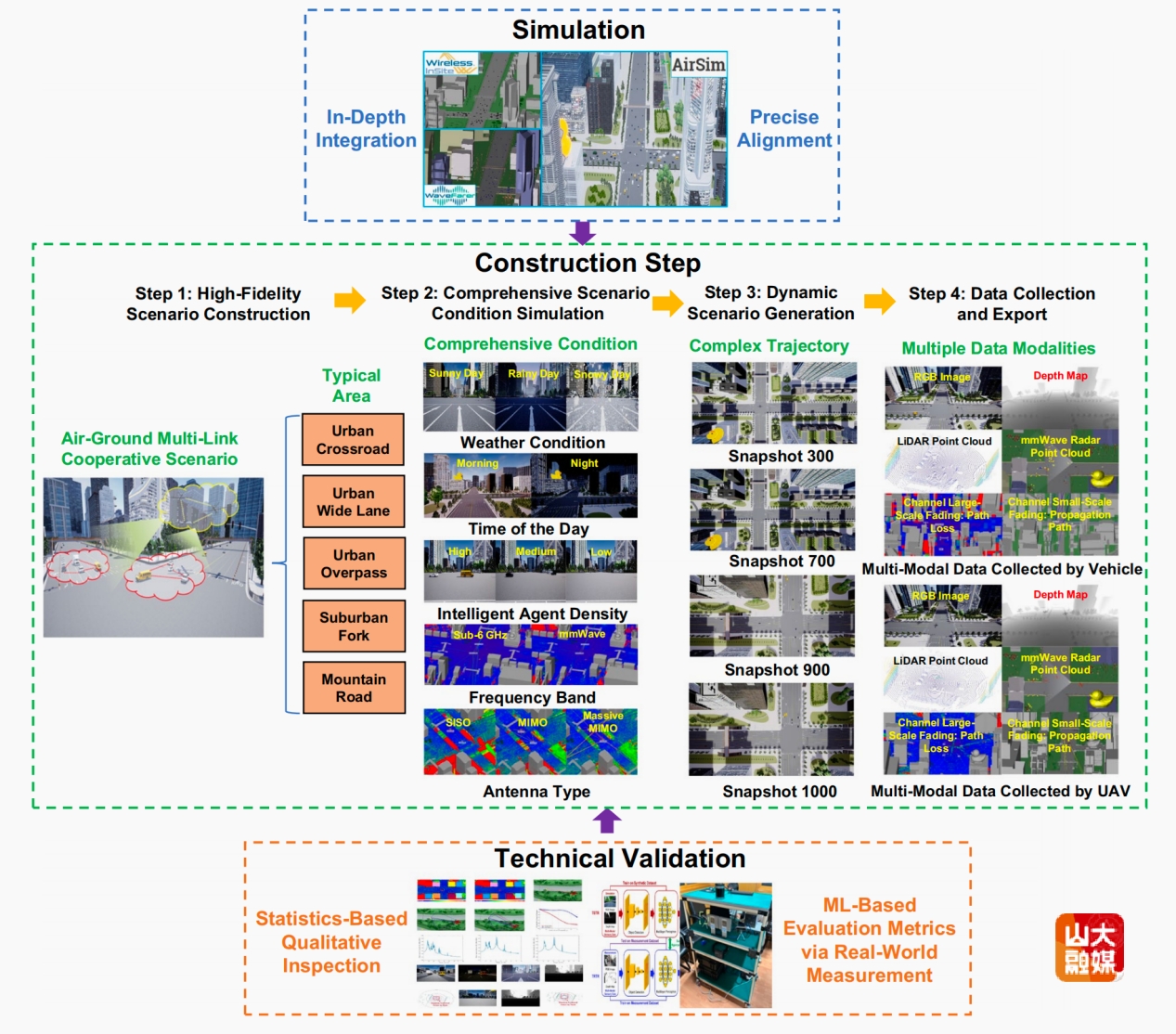

SynthSoM数据集包含多车和多路端的通信数据(包括sub-6 GHz、毫米波等不同频段和SISO、MIMO和大规模MIMO等不同天线阵列配置下的射频信道信息)与多模态感知数据(包括射频感知,即毫米波雷达信息,和非射频感知,即RGB图、深度图、激光雷达点云),涵盖了城镇、郊区、乡村等多种网联智能低空交通场景(多无人机-多车),并具有多时段、多天气、多视角、多车流量密度、多频段、多种天线阵列等丰富场景条件。SynthSoM数据集可广泛应用于智能交通、6G网络研究等多个领域,同时能够支撑无人驾驶、无人仓储等无人系统智能网联服务应用研发。

创新突破:填补通信与多模态感知智能融合数据集空白

随着人工智能(AI)与网联智能的迅猛发展,无人系统研发如火如荼,旨在大规模智能体利用多模态感知信息,借助网联协同进行信息共享决策,在复杂动态环境中执行多样化智能任务。作为AI算法研究的基础,一个完备的通信与多模态感知数据集必不可少。然而,现有的公开数据集数据模态有限,难以满足前沿通信与多模态感知智能融合研究的实际需求。为填补这一领域的空白,研究团队开发了一个全新的通信与多模态感知数据生成与采集平台,并基于该平台构建并发布了首个完备的通信与多模态感知智能融合数据集SynthSoM。该数据集包含了37.3万组通信信道数据、23万组毫米波雷达波形数据、45.5万张RGB图像、89.1万张深度图像及24.1万组激光雷达点云数据,为多模态数据融合及相关算法验证提供了重要的数据支持。

技术验证:高精度、多场景、多算法验证

为了验证SynthSoM数据集的可信度和可用性,研究团队采用了基于统计的定性分析和基于机器学习的评估指标两种方法。一方面,团队通过统计分析对比了仿真数据与实际测量数据的可视化效果和统计分布,并分析验证了不同天线配置下的传播路径,验证了SynthSoM数据集的准确性。同时,在射频感知数据与非射频感知数据的验证中,团队展示了毫米波雷达点云与环境变化之间的关系,证明了数据集在不同智能体密度和天气条件下的表现与实际测量结果相一致;另一方面,为进一步验证SynthSoM数据集的可信度和可用性,团队进行了基于机器学习的性能评估。通过“在仿真数据上训练,在实测数据上测试(TSTR)”和“在实测数据上训练与测试(TRTR)”的方法,团队验证了数据集的在真实场景中的数据可迁移性。通过上述两种验证方法,研究团队证明了SynthSoM数据集的可信度和可用性。

现阶段,SynthSoM数据集已全部开源。

白露教授,泰山学者青年专家,主要从事智慧网络与网联智能研究。系列研究成果已发表于Scientific Data、IEEE Communications Surveys & Tutorials、IEEE Transactions on Wireless Communications、IEEE Transactions on Communications、IEEE Transactions on Antenna and Propagation等国际期刊,相关研究受到国家自然科学基金、中国科协青年人才托举工程、泰山学者工程、山东省优青项目、小米青年学者等的资助。